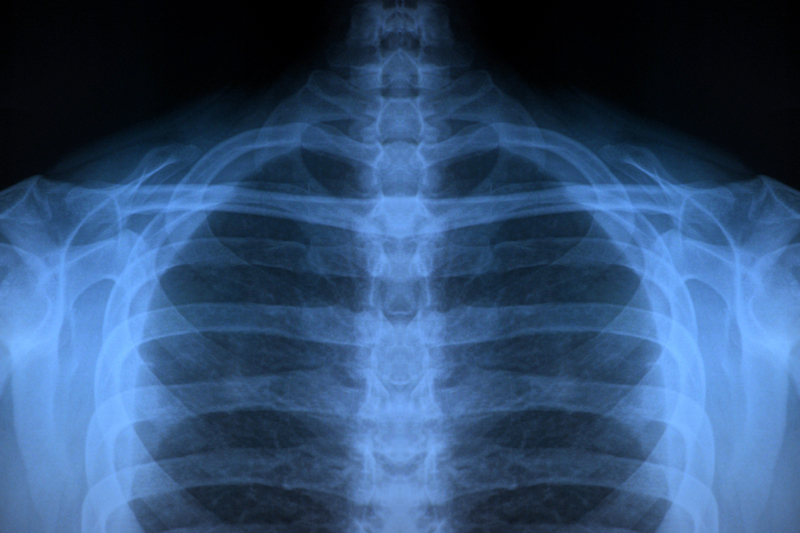

Radiografii false făcute de AI atât de bine încât au păcălit atât radiologi, cât și instrumentul care le-a creat. Cercetătorii trag un semnal de alarmă

Radiografiile false, generate de inteligența artificială (AI) astfel încât să semene cu rezultate reale provenite de la pacienți umani, pot păcăli atât radiologi cu experiență, cât și instrumentele AI în sine, conform unui studiu la care au luat parte 17 radiologi din 12 spitale aflate în șase țări, a scris Reuters.

Cei 17 radiologi au primit 264 de radiografii, dintre care jumătate fuseseră create de instrumente de AI ca ChatGpt sau RoentGen.

Când radiologii nu cunoșteau adevăratul scop al studiului, doar 41% dintre ei au identificat spontan imagini generate de AI, arată raportul publicat în revista Radiology.

Când au fost informați că în setul de date sunt și imagini sintetice, precizia medie a radiologilor în diferențierea imaginilor reale de cele sintetice a crescut la 75%.

„O vulnerabilitate cu mize mari”

Faptul că există radiografii deepfake suficient de realiste pentru a-i înșela pe radiologi „creează o vulnerabilitate cu mize mari pentru litigii frauduloase dacă, de exemplu, o fractură fabricată ar putea fi imposibil de distins de una reală”, a avertizat coordonatorul studiului, Dr. Mickael Tordjman de la Școala de Medicină Icahn de la Mount Sinai din New York, într-un comunicat.

El a atras atenția că „există, de asemenea, un risc semnificativ de securitate cibernetică în cazul în care hackerii ar obține acces la rețeaua unui spital și ar injecta imagini sintetice pentru a manipula diagnosticele pacienților sau ar provoca haos clinic pe scară largă prin subminarea fiabilității fundamentale a dosarului medical digital”.

Patru modele lingvistice mari, GPT-4o și GPT-5 de la OpenAI, Gemini 2.5 Pro de la Google și Llama 4 Maverick Meta, au detectat imaginile false cu o precizie care a variat între 57% și 85%.

Nu a fost detectate toate nici măcar de instrumentul cu care au fost generate

Nici măcar ChatGPT-4o, modelul care a creat radiografiile false, nu a reușit să le depisteze pe toate, chiar dacă a identificat mai multe decât celelalte instrumente, spun cercetătorii.

Aceștia consideră că s-ar putea impune crearea unor eventuale garanții digitale pentru a ajuta la distingerea imaginilor reale de cele false și pentru a preveni manipularea.

„Poate că vedem doar vârful aisbergului”, a declarat Tordjman despre posibilitatea unor scanări CT și RMN false. „Acum este esențială stabilirea unor seturi de date educaționale și a unor instrumente de detectare”, a conchis el.

FOTO: Ryan Lunn | Dreamstime.com